̫ƽ��Ƽ� AI

���������½������������ AI ѵ��������Ч��

С��ë

���α༭��wangkeyue

�����ڣ�2024-02-04 22:54

С��ë

���α༭��wangkeyue

�����ڣ�2024-02-04 22:54

|

������Supermicro���Ƴ���һ���µĽ��������רΪ����AI�ͻ���ѧϰ�����ݷ��ʶ���ơ��÷����ܹ��������GPU���ݴ���ܵ�����������AI��ֵʵ�ֵ�ʱ�䣬������֯�����ѵ��ģ�ͣ���Ѹ�ٽ�����Ӧ����AI������ �����Ľ�������ܹ���AIѵ�����洦����ת������PB��Petabyte�������ԭʼ���ݣ������伯�ɵ���ҵAI���������С��÷��������������컷���еõ���֤���ܹ�ΪAIOps��MLOps�ṩPB��ģ������������ Supermicro���ܲü���ϯִ�й�������ǿ����ͨ��ʹ��ÿ����20 PB�ĸ�Ч�ܿ����洢�����䱸�ĸ��Ż�Ӧ�õ�H100 8-GPU�����������˸�H100 8-GPU��Һ����������ͻ����Լ���AI��MLӦ�õ����С� ���⣬�ý������Ϊÿ���洢��Ⱥ�ṩ������270 GB/s�Ķ�ȡ��������390��IOPS������/�������ÿ�룩�����ҿ���������չ������PB�Ĺ�ģ��ͨ�����ʹ��PCIe 5.0��E3.S�洢�豸�Լ�WEKA Data Platform����������Supermicroϵͳ����һ����ʵ�ز��ԵĻ������������������û���AIӦ��Ч�ܡ� ������ָ����ͨ�����ȫ�µĴ洢����������ͻ��ܹ���ַ������Ƚ���GPU�����������������DZ�����Ӷ�������ӵ�гɱ���TCO�������AIЧ�ܡ� |

ԭ����Ŀ

IT�ٿ�

��������

�۳�ֵ•��ѡ

-

- �й���ͨ�ֻ����绰�������������������ٵ��������ǿ���ʿ���ӿ���ݿ��������ִ��� ��ѡ������ ��ݴ�88��3000����60G����

- ȯ��ʡ4

-

��1.6

��5.6

- �ٽ���μ���NAS����洢������˽���Ƽ�ͥ����������AX3000WiFi6��ͨ�ĺ�·����Space 1���̰�

- ��400��130

-

��479.0

��499.0

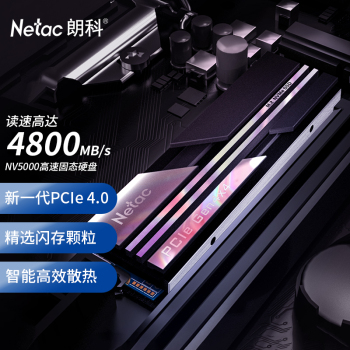

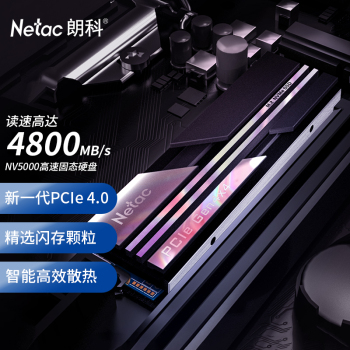

- �ʿƣ�Netac��1TB SSD��̬Ӳ�� M.2�ӿ�(NVMeЭ��PCIe 4.0 x4) NV5000��Ӱϵ�� 4800MB/s���� ���ܿ���

- ȯ��ʡ20

-

��469.0

��489.0

- ���ᣨSONY�� MDR-EX650AP ���ʽ���߶��� 3.5mm�ӿ� ֧��ͨ���߿ش����������ᾭ�䶯Ȧ�� ͭ��ɫ

- ȯ��ʡ50

-

��359.0

��409.0

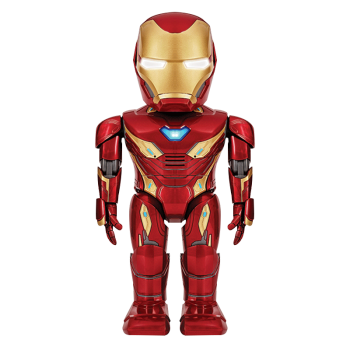

- �ű�ѡ��UBTECH��������MARK50���ܻ�����APP���Ƹ���������4�����ְ��ղ���Ů���������� ���̼�˳�ᷢ�����������������ܻ�����

- ȯ��ʡ200

-

��399.0

��599.0

-

- ��ҫ70 IMX800������ ˫������� ��ͨ����778G Plus 66W��� 5G�ֻ� 12GB+256GB ����ɫ

- ȯ��ʡ30

-

��1729.0

��1759.0

- �����ã�FOPATO��H98����������е������ģ���ƻ��Ȳ����Ϸ�칫Gasket�ṹPBT��ñRGB�ƹ�TTC�� ������� TTCĺɽ����

- ȯ��ʡ20

-

��979.0

��999.0

- ��ҫ90 2�����س������ ����յ��⻤���� 5000mAh�ᱡ������ 16GB+512GB ������ 5G

- ȯ��ʡ30

-

��2769.0

��2799.0

- ����27Ӣ�� ԭ������ 2K 170Hz FastIPS 1ms(GtG) HDR400 100%sRGB ��ת����������Ѫ�羺��ʾ��VX2781

- ȯ��ʡ50

-

��1549.0

��1599.0

- �Ⱥ�ʧ���ż���xbox��Ϸ�ֱ�pc����Steamdeck��������switch oled�����ֻ�ios��ƽ��rog�ƻ���˹��model

- ȯ��ʡ25

-

��174.0

��199.0

-

- Apple/ƻ�� iPad(�� 10 ��)10.9Ӣ��ƽ����� 2022���(256GB WLAN��/ѧϰ�칫����/MPQC3CH/A)��ɫ

- ȯ��ʡ700

-

��4099.0

��4799.0

- ��������Ӫ��Apple/ƻ��iPhone 14֧���ƶ���ͨ����5G˫�����ٷ���Ʒ�ֻ���ɫ

- ȯ��ʡ1100

-

��4299.0

��5399.0

- ���� WH850 ������λ���ֻ����ӻ�ͼ��д��������д����Ի滭��

- ȯ��ʡ3

-

��183.0

��186.0

- Apple/ƻ�� iPhone 15 Plus (A3096) 256GB ��ɫ ֧���ƶ���ͨ����5G ˫��˫���ֻ��������װ��

- ȯ��ʡ200

-

��7008.0

��7208.0

- Ħ������ moto razr 40 Ultra ���ľ�Ļ ��������Ӧ�� ���߳�� ����8+ 5G�۵����ֻ� 8GB+256GB ���ź�

- ȯ��ʡ100

-

��4899.0

��4999.0

-

- ASUS��˶�߶�����칫i7�����۵�4K��OLED��EVO��֤��д������360��ת��ת13.3Ӣ��С��Ļ���ᳬ���ʼDZ�����

- ȯ��ʡ200

-

��4889.0

��5089.0

- ��ҫX40 120Hz OLEDӲ������ 5100mAh ������ 7.9mm�ᱡ��� 5G�ֻ� 12GB+256GB ī����

- ȯ��ʡ30

-

��1399.0

��1429.0

- �������ݣ�WD��4TB NVMe �ƶ���̬Ӳ�̣�PSSD��P50 type-c xbox��Ϸ������ssd����ֻ��ʼDZ��洢 2000MB/s

- ȯ��ʡ50

-

��2249.0

��2299.0

- AMD ������� ��װ������ ��VEGA���� 7nmCPU AM4�ӿ� R5 5600G��ɢƬ���������ԣ�

- ȯ��ʡ30

-

��789.0

��819.0

- ��������WD ssd��̬Ӳ�� m.2 nvme������Ϸ �ʼDZ�����̨ʽPS5 ϵͳ����DIYװ������ SN770����ϵ�У�PCIe4.0�ӿڣ� 1TB

- ȯ��ʡ50

-

��519.0

��569.0

С��ë

С��ë

Ӳ������ʷ

Ӳ������ʷ